Rude Baguette a rencontré Annie Mullins OBE, fondatrice du cabinet de conseil Trust + Safety Group et conseillère en matière de protection des utilisateurs pour le réseau social Yubo. Nous avons parlé des algorithmes sur mesure utilisés par la plateforme, de sa politique de sécurité et des difficultés posées par la protection des jeunes en ligne.

Rude Baguette : Parlez-nous de vous et de votre rôle auprès de Yubo.

Annie Mullins : Je suis une experte en sécurité digitale qui, dès mes débuts en tant que travailleuse sociale qualifiée et experte en protection, a dédié sa carrière à la protection des enfants. J’ai commencé à travailler sur des thématiques liées à internet vers 2001, lorsque j’ai collaboré avec Yahoo sur la question de la sécurité des enfants en ligne. J’ai ensuite travaillé chez Vodafone pendant 10 ans, alors qu’internet faisait son apparition sur les téléphones mobiles.

Puis j’ai travaillé en tant qu’experte indépendante auprès de réseaux sociaux ces six dernières années, mettant en œuvre leurs règlements d’utilisateurs et créant des mécanismes de protection ad hoc. J’ai accumulé une grande expérience dans le développement de systèmes d’autorégulation et la mise en œuvre de recommandations de bonnes pratiques pour le secteur au Royaume-Uni et en Europe continentale.

J’ai rejoint Yubo il y a environ deux ans et demi, suite à une campagne de dénigrement dans la presse qui les comparait à Tinder. Je les ai aidés à innover en développant une stratégie de protection des utilisateurs et des enfants qui nous permet de réagir immédiatement en cas de problème, tout en facilitant le travail des forces de l’ordre. Notre objectif était de nous assurer que notre politique permette d’établir des règles pour notre communauté, sur le fondement desquelles nous basons aujourd’hui notre action.

RB : Quels changements concrets avez-vous mis en œuvre afin de répondre aux critiques dont l’entreprise a fait l’objet ?

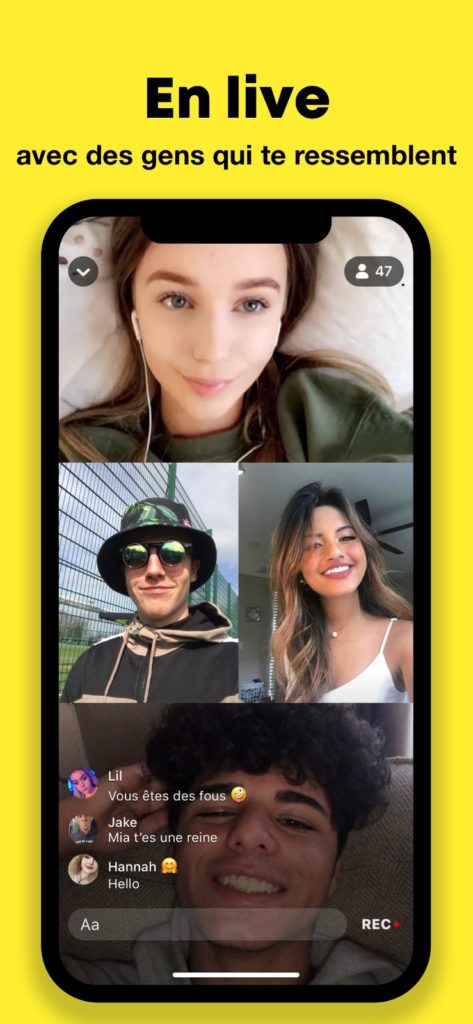

AM : Nous avons tout d’abord établi des règles éthiques et responsables à l’intention des utilisateurs. Notre clientèle comprend beaucoup d’adolescents qui diffusent des flux depuis leur chambre. Ils sont en pleine explosion hormonale, ce qui les pousse à expérimenter et repousser les limites. Fallait-il leur autoriser d’être en sous-vêtements, aux garçons ou aux filles d’être topless, de montrer leur corps ? Cette question a permis d’établir notre première grande politique : non, cela n’est pas acceptable, et nous ne le tolèrerons pas sur notre plateforme.

Ensuite Yubo a développé des algorithmes capables de déterminer si quelqu’un est nu ou en culotte. Ils analysent les diffusions en direct – avec la possibilité de les interrompre en fonction de la gravité du comportement que l’algorithme pense avoir identifié. Si les utilisateurs sont en sous-vêtements, un modérateur leur enverra une sommation de s’habiller décemment. Ils auront alors une minute pour le faire avant que nous coupions le flux.

Si nous ne fermons pas systématiquement leurs comptes, il est possible de les clôturer temporairement afin de laisser nos utilisateurs réfléchir à ce qu’ils ont fait. Notre but est d’éduquer la jeunesse, pas de la punir. Nous les aidons à comprendre ce qu’il s’est passé, pourquoi cela allait à l’encontre des règles et pourquoi cela présentait un risque potentiel pour eux.

Les gens ne lisent pas les conditions d’utilisation des services ou les règlements communautaires, aussi une intervention en live, pendant la diffusion de flux, est une approche innovante. Yubo a choisi une approche très responsable aux enjeux posés par le fait que de nombreux jeunes utilisaient ses services : nous fixons des limites et rendons nos utilisateurs responsables de leur comportement.

RB : L’algorithme utilisé est-il une marque déposée ou est-il lié au service Yoti ?

AM : Pour la reconnaissance de nudité – totale ou partielle – lors des diffusions live, il s’agit d’un algorithme propre à Yubo, qui n’a rien à voir avec Yoti.

Les services de Yoti nous servent en revanche à vérifier la véracité des profils de nos utilisateurs. Cela nous est tout particulièrement utile afin de nous assurer qu’aucun d’entre eux n’a moins de 13 ans – ce qui est fréquent sur le marché scandinave, où les plus jeunes sont déjà équipés de téléphones mobiles. Lors des premiers mois, quelque 20 000 profils ont ainsi été supprimés.

Nous avons également pu diviser notre communauté par tranches d’âges : ceux qui ont mois de 18 ans, ceux qui ont 18 ans et ceux qui ont plus. Et si nous trouvons une photo de profil qui ne correspond pas à l’âge déclaré, nous utilisons le système de vérification de Yoti, qui demande des pièces d’identité aux utilisateurs, sans que nos propres services n’aient à prendre en charge les contrôles.

RB : Pensez-vous que d’autres réseaux sociaux pourraient apprendre de l’expérience de Yubo ?

AM : Bien sur ! Je pense qu’ils devront se pencher sur ces questions. Les gouvernements, les législateurs, les ONG et les défenseurs des droits savent tous que la question de l’identité est absolument cruciale. C’est vrai pour les services bancaires, les services publics, les achats en ligne… Il en va de même pour les réseaux sociaux. Il faut une approche beaucoup plus responsable devant le terrorisme et tout ce qui se passe dans le monde aujourd’hui. Je pense que la pression pour trouver des réponses à ces phénomènes s’accroit. Yubo est à la pointe de ces développements.

RB : Est-il possible d’améliorer votre système ?

AM : Evidemment ! Nous voulons désormais nous assurer que les photos de profil soient celles des vrais utilisateurs – pas de leur chien ou de leur chat – et nous y travaillons. Tous les problèmes ne seront jamais réglés en matière de sécurité des utilisateurs. Il faut constamment se dépasser, améliorer le produit et les méthodes de protection employées. Il y a toujours des progrès à faire.

RB : Pensez-vous que l’aspect éducatif de votre algorithme a aidé les adolescents qui utilisent Yubo à avoir un comportement en ligne globalement plus responsable ?

AM : Oui. Je pense que tout est une question de comportement responsable. Nous avons affaire à des adolescents avec des hormones en ébullition : les enseignants, les parents et les services comme Yubo ont pour responsabilité de fixer des limites et de leur donner des outils afin qu’ils sachent quand ils prennent un risque inconsidéré. Comme je le disais, il ne s’agit pas de les punir mais de les aider à fixer leurs propres limites et à apprendre en utilisant des réseaux sociaux comme Yubo.

Lorsque nous émettons des mises en garde, non seulement les personnes concernées cessent rapidement les infractions au règlement, mais le message se diffuse rapidement au sein de la communauté. Les utilisateurs peuvent en effet voir quand un contact reçoit un avertissement ou quand son flux est interrompu. Ils commencent à s’autogérer, à fixer leurs propres limites et se dire « ne fais pas ça, tu vas t’attirer des ennuis ». C’est un signal très positif.

Les questions comportementales sont réellement aussi importantes que les outils technologiques lorsqu’il s’agit de responsabiliser les gens et de les accompagner afin qu’ils puissent prendre davantage soin d’eux-mêmes. L’éducation joue un rôle crucial puisqu’il s’agit d’adolescents, encore en plein développement et en plein processus d’apprentissage, ce que nous devons encourager. Les plateformes ont comme responsabilité de s’assurer que les environnements dans lesquels les jeunes interagissent, se parlent, se confient, s’amusent, soient aussi positifs et sécurisés que faire se peut.

RB : Quelle est votre évaluation des efforts entrepris par Facebook dans ce domaine ?

AM : Ils ont déployé de grands efforts pour améliorer les choses. Dire le contraire serait mentir. Et ils agissent à une échelle titanesque, ce qui est un enjeu en soi. Ils ont lancé des initiatives pour lutter contre le terrorisme et des algorithmes qui permettent d’identifier une grande variété de contenus dangereux afin de protéger leurs utilisateurs.

Ils n’ont en revanche pas été proactifs en ce qui concerne leurs produits et services, à mon avis. Facebook a beaucoup fait en réaction à des problèmes, comme le développement d’une base de données en cache qui permet d’identifier les contenus illégaux, comme les images pédopornographiques. Il ne fait aucun doute qu’ils œuvrent constamment pour s’améliorer. Mais peut-être qu’ils ont sous-estimé le travail préventif grâce auquel de nombreuses fautes sont évitées, qui protège à la fois les utilisateurs les uns des autres mais aussi d’eux-mêmes.

Pour conclure, voulez-vous ajouter quelque chose ?

AM : La sécurité fait désormais partie de l’ADN de Yubo. C’était un développement inévitable. Une compagnie qui fait preuve de négligence ne peut pas survivre. On ne laissera pas des milliers d’adolescents courir le risque de se faire du mal et de faire du mal aux autres. Et c’est ça qui compte.